Meta通过开源Llama 3 LLM提高了标准

Meta 推出了 Llama 3,这是其最先进的开源大型语言模型(LLM)的下一代产品。这家科技巨头声称,Llama 3 在现实场景中建立了新的性能基准,超越了之前行业领先的模型,如 GPT-3.5。

Meta 在一篇博文中宣布了这一发布,并表示:”通过 Llama 3,我们致力于打造与当今最好的专有模型相媲美的最佳开源模型。”

目前开放的 Llama 3 模型包括 80 亿和 700 亿参数版本。Meta 表示,其团队正在继续训练更大的 4000 亿+参数模型,这些模型将在未来几个月内发布,同时还将发布详细的研究论文。

Llama 3 的开发历时两年多,投入了大量资源来组建高质量的训练数据、扩大分布式训练、优化模型架构,以及采用创新的指令微调方法。

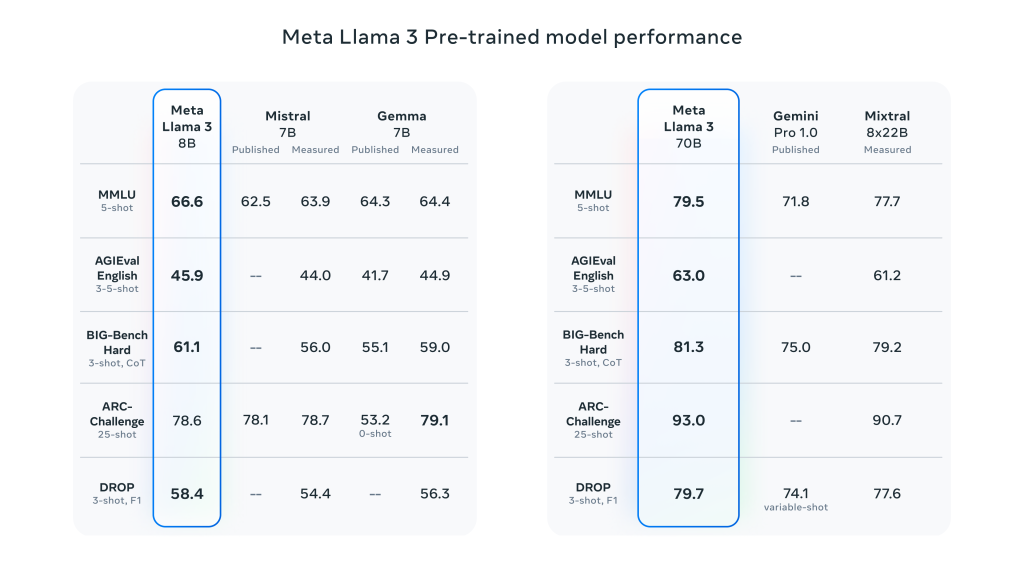

Meta 的 700 亿参数指令微调模型在涵盖编码、推理和创意写作等 12 个关键使用场景的人工评估中,表现优于 GPT-3.5、Claude 和其他同规模的 LLM。该公司的 80 亿参数预训练模型在流行的 LLM 评估任务中也创下了新的基准。

Meta 表示:”我们相信这些是同类中最好的开源模型,毫无疑问。”

这家科技巨头采取”默认开放”的方式发布这些模型,以进一步促进人工智能发展的开放生态系统。Llama 3 将在所有主要云服务提供商、模型托管商、硬件制造商和人工智能平台上提供。

Iris.ai 的首席技术官兼联合创始人 Victor Botev 表示:”随着全球向人工智能监管转变,Meta 推出 Llama 3 模型值得关注。通过开源透明化,Meta 与日益强调负责任的人工智能实践和道德发展的趋势保持一致。

“此外,这为更广泛的社区教育提供了机会,因为开放模型有助于洞察发展过程,并能够审查各种方法,这种透明度反过来又有助于制定和执行相关法规。”

随着 Meta 最新模型的发布,还推出了更新的人工智能安全工具套件,包括 Llama Guard(用于风险分类)和 CyberSec Eval(用于评估潜在滥用)的第二代版本。此外,还引入了一个名为 Code Shield 的新组件,用于在推理时过滤不安全的代码建议。

Botev 继续说道:”然而,我们必须保持客观 - 一个模型仅仅是开源的,并不等同于道德的人工智能。解决人工智能的挑战需要采取全面的方法来应对数据隐私、算法偏差和社会影响等问题,这些都是全球新兴人工智能法规的关键焦点。

“虽然像 Llama 3 这样的开放举措促进了审查和协作,但它们的真正影响取决于对人工智能治理合规性和在人工智能系统生命周期中嵌入道德的整体方法。Meta 在 Llama 模型方面的持续努力是迈向正确方向的一步,但道德人工智能需要所有利益相关方的持续承诺。”

Meta 表示,它已采取”系统级方法”来确保 Llama 3 的负责任发展和部署。尽管这些模型已经经过了广泛的安全测试,但该公司强调开发者应根据应用程序的要求实施自己的输入/输出过滤。

Meta 将 Llama 3 集成到其 Meta AI 产品中,声称这现已成为世界领先的人工智能助手。用户可以通过 Facebook、Instagram、WhatsApp、Messenger 和网络访问 Meta AI,用于生产力、学习、创造力和一般查询。

集成视觉功能的 Meta AI 多模态版本正在开发中,早期预览将推出到 Meta 的 Ray-Ban 智能眼镜上。

尽管 Llama 3 取得了巨大成就,但人工智能领域的一些人对 Meta 的动机是否真的是出于”为了社会的利益”而采取开放方式表示怀疑。

然而,就在 Mistral AI 以 Mixtral 8x22B 创下开源模型新基准的第二天,Meta 的发布再次提高了可公开获得的大型语言模型的标准。