OpenAI现已普遍提供带有视觉应用程序接口的GPT-4 Turbo

OpenAI宣布,其功能强大的GPT-4 Turbo with Vision模型现已通过公司的API全面推出,为企业和开发人员将高级语言和视觉功能集成到其应用程序中开辟了新的机会。

继去年 9 月首次发布 GPT-4 的视觉和音频上传功能,以及 11 月在 OpenAI 开发者大会上发布 GPT-4 Turbo 涡轮增压模型之后,GPT-4 Turbo with Vision 也在 API 上推出。

GPT-4 Turbo 可显著提高速度,扩大输入上下文窗口,最多可容纳 128,000 个令牌(相当于约 300 页),并提高开发人员的经济承受能力。

一个关键的增强功能是 API 请求能够通过文本格式 JSON 和函数调用利用模型的视觉识别和分析功能。这样,开发人员就可以生成 JSON 代码片段,在连接的应用程序中自动执行操作,如发送电子邮件、购物或在线发布。不过,OpenAI 强烈建议在采取影响现实世界的行动之前,先建立用户确认流程。

(PS:使用Wildcard享受不受网络限制的API调用,详情查看教程)

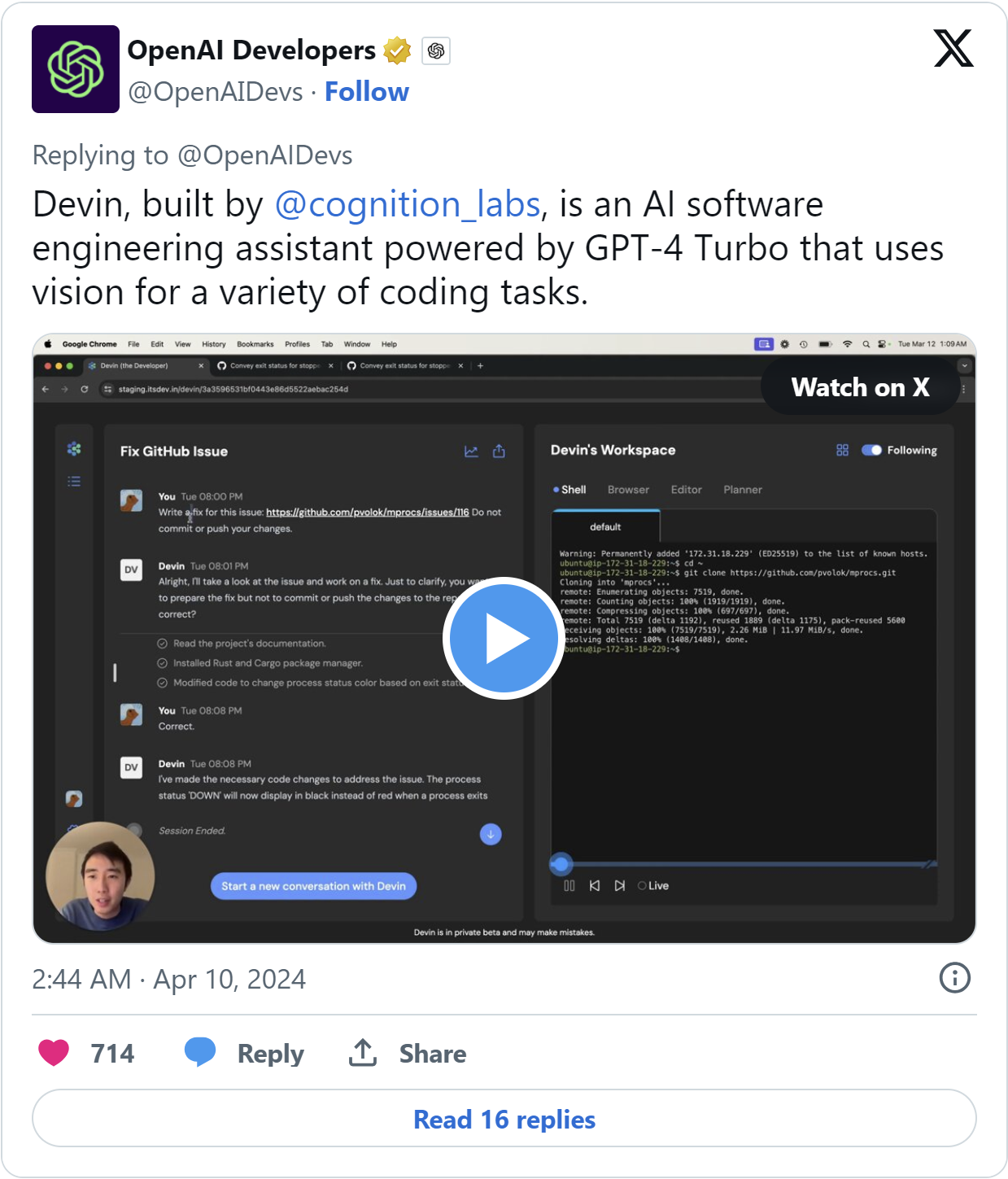

一些初创公司已经在利用 Vision 的 GPT-4 Turbo,其中包括Cognition,该公司的人工智能编码代理 Devin 依靠该模型自动生成完整代码:

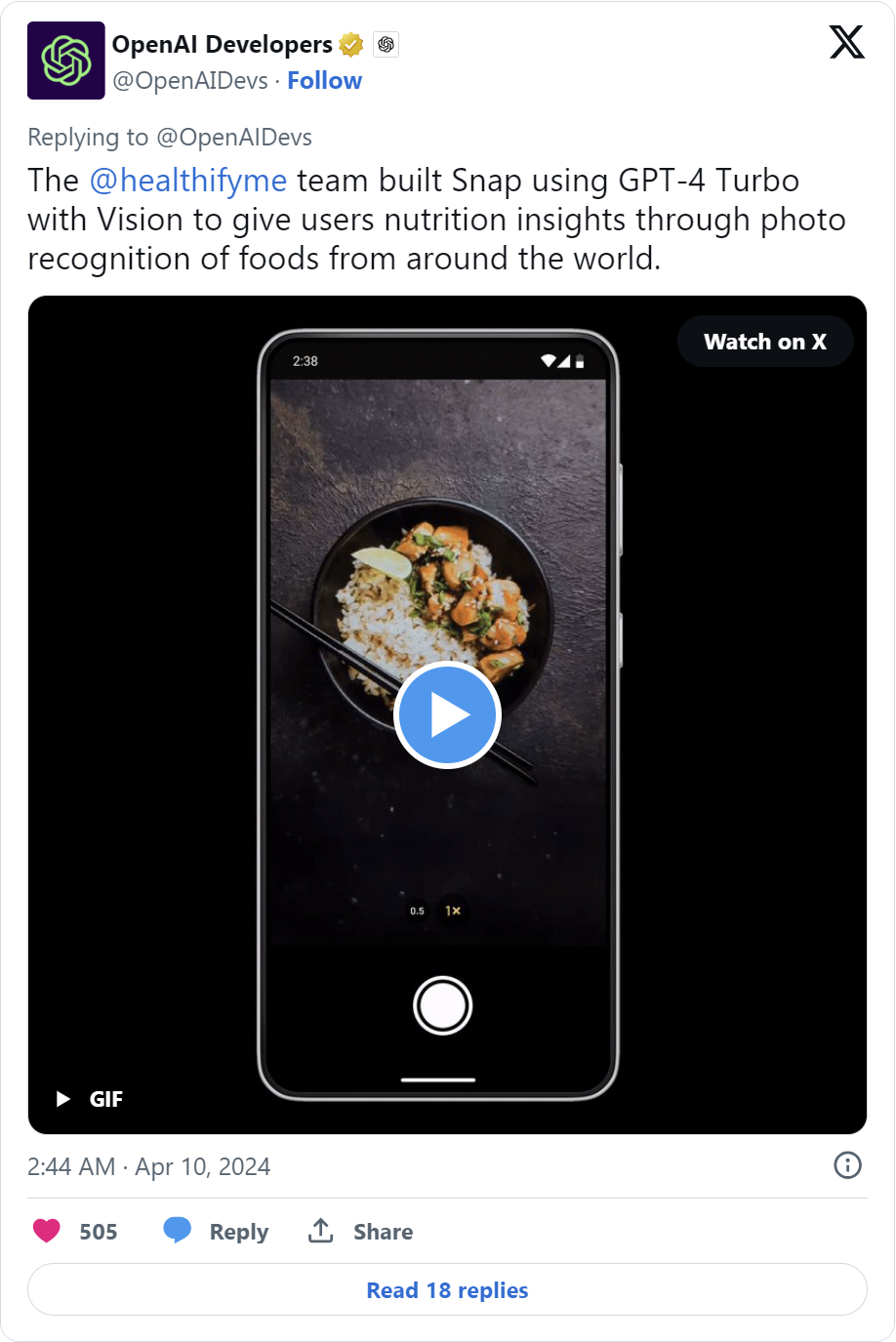

Healthify是一款健康和健身应用程序,它利用该模型根据膳食照片提供营养分析和建议:

TLDraw 是一家位于英国的初创公司,它采用 GPT-4 Turbo with Vision 为其虚拟白板提供动力,并将用户绘制的图纸转换为功能网站:

尽管面临着 Anthropic 的 Claude 3 Opus 和谷歌的 Gemini Advanced 等较新模型的激烈竞争,但随着开发人员等待 OpenAI 的下一个大型语言模型,API 的发布应有助于巩固 OpenAI 在企业市场的地位。